طوّر باحثون من غوغل براين (Google Brain) برنامجًا حاسوبيًا جديدًا يستطيع أن يوفّر مقالاتٍ على شكل مقالات ويكيبيديا بتلخيص معلوماتٍ من الويب. هذا البرنامج المطوّر من قبل مهندسي غوغل، يقوم بكشط أوّل عشر صفحات ويب متعلّقة بموضوعٍ ما، باستثناء تدوين الويكيبيديا (يمكننا التفكير به على أنّه عملية تلخيص لأوّل عشرة نتائج لبحثٍ في غوغل). أغلب هذه الصفحات تستعمل خوارزميات التعلّم الآلي (the machine-learning algorithm)، في حين أنّ البعض يبقى لاختبار والتحقق من صحة نتائج البرنامج.

فقراتٌ من كلّ صفحة تُجَمّع و تُرَتب من أجل إنشاء ملفٍ طويل، والذي يتمّ اختصاره لاحقًا بفصله إلى 32 ألف كلمة فردية. هذا النص الضخم يُستعمل كإدخال (Input) لنموذج تلخيصي أين يتمّ تقطيع الجمل الطويلة إلى جمل أقصر – حيلة لتقصير النص.

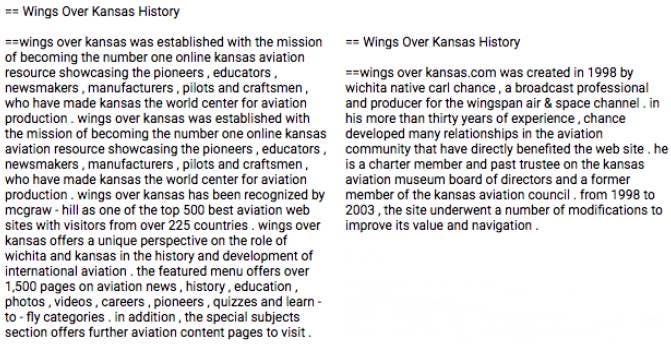

لأنّ الجمل الناتجة هي في الأصل مختصرة، من مرحلة الاستخلاص الأولية بدلًا من الكتابة من الصفر، فالنتيجة النهائية يمكن أن تبدو ركيكة وفيها تكرار. يمكنك أن تلاحظ الفرق بين ما كتبه البرنامج مقارنةً بالنصّ البشريّ المحرر حاليا في ويكيبيديا (باللغة الإنجليزية، على اليسار المحتوى المكتوب بواسطة البرنامج، على اليمين النص المحرر من طرف البشر).

“محمد صالح” ورفاقه في “غوغل براين” يأملون أن يكون بإمكانهم تحسين روبوتهم بتصميم نماذج ومعدّات (Hardware) قادرة على تحمّل إدخالات متسلسلة أطول، دراستهم ستقدّم في المؤتمر الدولي (ICLR: International Conference on Learning Representations)

“محمد صالح” ورفاقه في “غوغل براين” يأملون أن يكون بإمكانهم تحسين روبوتهم بتصميم نماذج ومعدّات (Hardware) قادرة على تحمّل إدخالات متسلسلة أطول، دراستهم ستقدّم في المؤتمر الدولي (ICLR: International Conference on Learning Representations)

كما هي الأمور الآن، سيكون من غير الحكمة امتلاك تدوينات Wiki مكتوبة بواسطة هذا الذكاء الاصطناعي ولكن، التطوّر أحسن. ربما يومًا ما، حلٌ هجين بين محتوى الذكاء الاصطناعي وإشراف الإنسان يمكن أن يملأ ويكيبديا بمعدّلاتٍ غير مسبوقة. حاليًا، ويكيبيديا بالّلغة الإنجليزية وحدها تملك حوالي 5،573،495 مقالًا بمختلف الأحجام، وويكيبيديا المدمجة لكلّ اللغات الأخرى تفوق الويكيبيديا الإنجليزية بكثير، حيث تشمل أكثر من 27 مليار كلمة في 40 مليون مقال بـ 293 لغة. هذا كثير، ولكن بحلٍّ من الذكاء الإصطناعي يمكننا حتى أن نأتي بكمية أكبر من المعلومات.

وفي حالة ما إذا أصبح الذكاء الاصطناعي يومًا ما جيِّدا كفاية ليعمّر ويكيبيديا، ربّما سيصبح جيّدًا كفاية لكتابة أيّ نوعٍ من المحتويات الأخرى، فلن تصبح بحاجة للدّفع لشخصٍ ليكتب لك مقالة، أو ”تفضّلوا بقبول فائق الاحترام” من أجل الأخبار. الذكاء الاصطناعي الكاتب للأخبار هو في الحقيقة متطوّر في هذه الأيام، مثلًا، Reuters’ algorithmic prediction tool يساعد الصحفيين على قياس نزاهة تغريدةٍ ما، الـ BuzzBot يجمع معلوماتٍ من مصادرَ من قلب الحدث في مناسبات الأخبار، وتستعمل “واشنطن بوست” برنامج الذكاء الاصطناعي خاصّتها المسمّى (Heliograf) لكتابة أخبارٍ قصيرة.

المصدر: هنا

تدقيق لغوي: بن يمينة هاجر